ハイクオリティなイラストを生成できるAIとして話題のStable Diffusionですが、その中でも2次元キャラクターのクオリティを劇的に向上させるモデルがあることがわかりましたので、使用方法を解説していきたいと思います。

以下のページで自然言語処理モデルGPT-3を使ったライティングツールCatchyで、Stable DiffusionのPromptを自動生成する方法について解説していますので、あわせてご覧ください。

Waifu Diffusionとは

ハイクオリティなイラストを生成できるお絵かきAI、Stable Diffusionをさらに2次元イラストに特化させるためのチューニングが行われたモデルがWaifu Diffusionです。

Waifu Diffuisonのリポジトリは以下となります。今回はこのモデルを使って2次元キャラクターを描かせてみようと思います。

Waifu Diffusionの実装

ベースとなるStable Diffusionのインストールと実装するためのソースコードの解説は以下のページでまとめていますので、あわせてご覧ください。

WaifuDiffusionの使用方法はいたって簡単で、モデルを指定する箇所を”hakurei/waifu-diffusion”に変更するだけです。

先ほどのStable Diffusionの使用方法を解説しているページに掲載しているソースコードの、パイプラインの設定部分を以下のように変更してください。

pipe = StableDiffusionPipeline.from_pretrained("hakurei/waifu-diffusion", use_auth_token=YOUR_TOKEN)作成したソースコード

今回作成したソースコードは以下の通りです。

このコードを実行する前に先ほど紹介した「無料で使える描画AI!Stable Diffusionで画像を生成する方法」の解説に従いStable Diffusionのインストールを済ませておいてください。

モデルの変更に伴う箇所は8行目のパイプラインの設定の一行だけとなります。

また今回は一度の実行で10枚のイラストを生成するように変更しました。

from diffusers import StableDiffusionPipeline

from datetime import datetime

#HuggingFaceのトークン

HF_TOKEN = "〇〇"

#StableDiffusionパイプライン設定

pipe = StableDiffusionPipeline.from_pretrained("hakurei/waifu-diffusion", use_auth_token=HF_TOKEN)

#使用するデバイスを設定

pipe.to("cuda")

#pipe.to("cpu")

#生成したい画像を指示

prompt = "〇〇"

#10枚続けて生成

for i in range(10):

#画像生成

image = pipe(prompt, height=512, width=768)["sample"][0]

#ファイル名に日時を付ける

date = datetime.now().strftime("%Y%m%d_%H%M%S")

path = date + ".png"

image.save(path)使用するデバイスでGPUが使えない場合は11行目を”cpu”に変更してください。

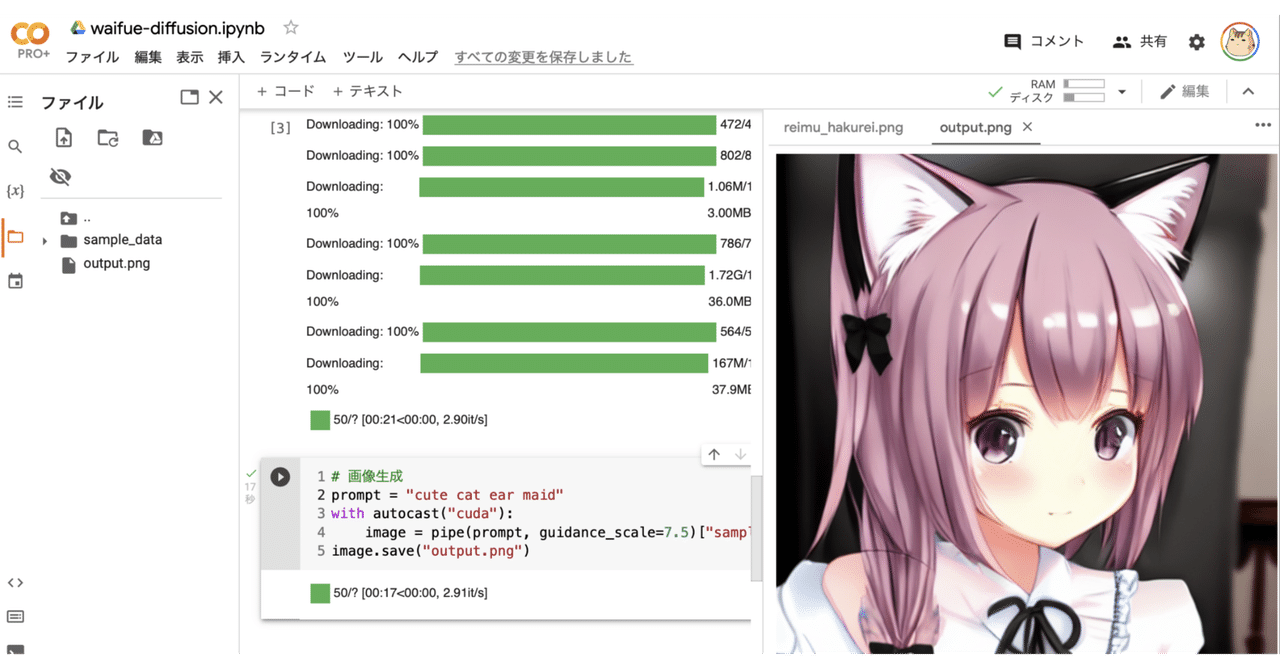

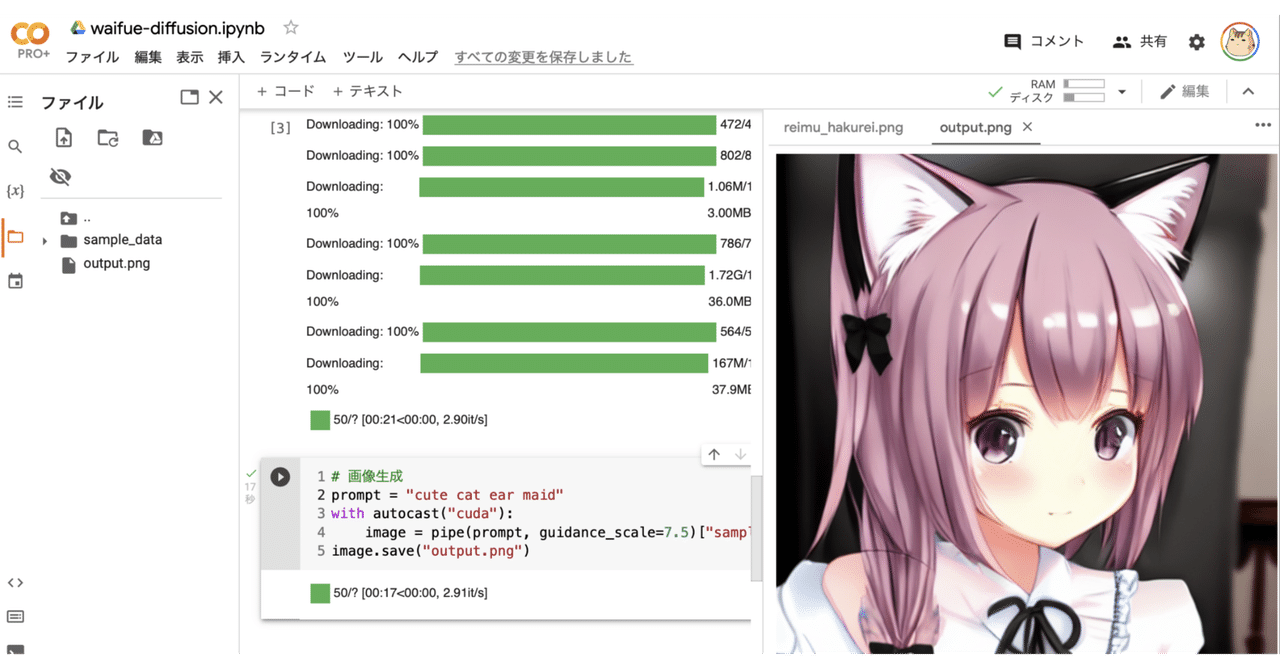

実行結果

今回は動作テストのためchiliさんがTwitterで公開されている呪文をおかりしました。

生成された絵の1枚がこちらです。

20枚ほど作っただけでかなりクオリティが高い画像が数枚出てきました。

以前のモデルだと人物は100枚生成して1~3枚くらい良い絵が出てくるかなといった感じでしたので、Waifu Diffusionに変更したことで2次元女性キャラクタークオリティが劇的に向上しています。

Stable Diffusionのテクニックを効率よく学ぶには?

カピパラのエンジニア

カピパラのエンジニアStable Diffusionを使ってみたいけど、ネットで調べた情報を試してもうまくいかない…

そんな時は、操作方法の説明が動画で見られるUdemyがおすすめだよ!

動画学習プラットフォームUdemyでは、画像生成AIで高品質なイラストを生成する方法や、AIの内部で使われているアルゴリズムについて学べる講座が用意されています。

Udemyは講座単体で購入できるため安価で(セール時1500円くらいから購入できます)、PCが無くてもスマホでいつでもどこでも手軽に学習できます。

Stable Diffusionに特化して学ぶ

Stable Diffusionに特化し、クラウドコンピューティングサービスPaperspaceでの環境構築方法から、モデルのマージ方法、ControlNetを使った構図のコントロールなど、中級者以上のレベルを目指したい方に最適な講座です。

画像生成AIの仕組みを学ぶ

画像生成AIの仕組みについて学びたい方には、以下の講座がおすすめです。

画像生成AIで使用される変分オートエンコーダやGANのアーキテクチャを理解することで、よりクオリティの高いイラストを生成することができます。

まとめ

今回はハイクオリティな2次元キャラクターを量産できるモデルWaifu Diffusionを紹介しました。人物のイラストを生成する際の成功率が劇的に上昇しますので、2次元美少女を描いてみたい方はぜひ試してみてください。

以下のページで自然言語処理モデルGPT-3を使ったライティングツールCatchyで、Stable DiffusionのPromptを自動生成する方法について解説していますので、あわせてご覧ください。

また、以下の記事で効率的にPythonのプログラミングスキルを学べるプログラミングスクールの選び方について解説しています。最近ではほとんどのスクールがオンラインで授業を受けられるようになり、仕事をしながらでも自宅で自分のペースで学習できるようになりました。

スキルアップや副業にぜひ活用してみてください。

スクールではなく、自分でPythonを習得したい方には、いつでもどこでも学べる動画学習プラットフォームのUdemyがおすすめです。

講座単位で購入できるため、スクールに比べ非常に安価(セール時1200円程度~)に学ぶことができます。私も受講しているおすすめの講座を以下の記事でまとめていますので、ぜひ参考にしてみてください。

それではまた次の記事でお会いしましょう。

参考

コメント