今回はStable Diffusionでリアル系イラストを生成できるモデルを紹介します。

Stable Diffusionではどのようなモデルを使用するかによって、生成される画像のクオリティが大きく変わりますので、モデルの選択は重要な要素となります。

本記事で紹介するモデルは、どれも実写と見分けがつかないほどハイクオリティなイラストを生成できますので、ぜひ試してみてください。

- Stable Diffusionで使用できるフォトリアル系(実写)モデルの特徴

- 各モデルでどのような画像が生成できる(生成画像サンプル)

- 各モデルの入手先

- WebUIでのモデルの設定方法

Stable Diffusionのアニメ調モデルについては、以下の記事で紹介しています。

また、当ブログのStable Diffusionに関する記事を以下のページでまとめていますので、あわせてご覧ください。

Stable Diffusionの導入方法から応用テクニックまでを動画を使って習得する方法についても以下のページで紹介しています。

Stable Diffusionとは

Stable Diffusion(ステーブル・ディフュージョン)は2022年8月に無償公開された描画AIです。ユーザーがテキストでキーワードを指定することで、それに応じた画像が自動生成される仕組みとなっています。

NVIDIAのGPUを搭載していれば、ユーザ自身でStable Diffusionをインストールし、ローカル環境で実行することも可能です。

(出典:wikipedia)

Stable Diffusionの使い方

Stable Diffusionでフォトリアル系のイラストを生成する方法を以下の記事で解説しています。

後程、紹介するモデルを利用するためには、Stable Diffusionの環境を構築しておく必要がありますので、事前に済ませておいてください。(モデルの配置方法についても記載しています)

フォトリアル系(実写)モデル紹介

Stable Diffusionでリアル系のイラストが生成できるマージモデルを紹介します。

fuduki_mix(2023/08/30)

fuduki_mixは「yayoi_mix」「kisaragi_mix」の製作者、こたじろうさんが公開されているモデルです。SDXLをベースとしており、ハイクオリティなアジア人風の人物を描画できるフォトリアル系モデルです。

fuduki_mixで生成した画像

配布先

BRA(Beautiful Realistic Asians) V6(2023/07/23)

PleaseBanKaiさんのハイクオリティな背景(特に街中の人混みなど)と人物を両立した、BRA最新のV6が公開されました。

アジア系の女性を描きたい人にもおすすめです。

BRA(Beautiful Realistic Asians) V6で生成した画像

配布先

BracingEvoMix(2023/6/2)

「chilled_remix」、「GenesisLifeMix」の制作者である鎖城郎郭さんの新作モデルです。

極東アジア人の顔の人物を生成できるモデルとなっています。

BracingEvoMixで生成した画像

配布先

chilled_remix_v2(2023/5/29)

鎖城郎郭さんが公開されているChilloutMixのジェネリックモデル、chilled_remixの最新バージョンであるv2が公開されました。

最新バージョンでも非常にクオリティの高いアジア系の美少女が生成できます。

また、これに伴い、chilled_remix_v1は公開終了となりました。

chilled_remix_v2で生成した画像

配布先

BRA(Beautiful Realistic Asians) V5(2023/5/6)

リアルな風景が描画できるモデルBRAの最新バージョンです。

特に背景の描画が非常にリアルで、街中の人混みなどを生成したい場合に重宝するモデルです。

人物の安定感も非常に高いです。

BRAV5で生成した画像

配布先

CutyElfMix(2023/4/30)

フォトリアル系でファンタジー世界のエルフ風キャラクターを生成できるモデルです。プロンプトでエルフの耳の形状を指定しなければ、通常の人間を生成することも可能です。あいもりさんがTwitterでモデルのレシピを公開されています。

CutyElfMixで生成した画像

配布先

CutyElfMixはモデルとしては配布されておらず、レシピを元に自分でマージモデルを作成することで利用できます。

CutyElfMixの作り方を以下の記事で解説しています。(機械学習やプログラミングの知識がなくても作成できます)

GenesisLifeMix(2023/4/28)

スラブ系の女性が生成できるモデルです。プロンプトで「Japanese idle」等のキーワードを入れると、日本人風の人物も生成できますので、少し大人びた顔立ちや、つり目要素が欲しい場合におすすめのモデルです。

GenesisLifeMixで生成した画像

配布先

Soda Mix(2023/4/25)

Umiseさんが公開されているモデルです。リアル系モデルですが、アニメキャラっぽい顔立ちのキャラクターを生成できます。

Soda Mixで生成した画像

配布先

chilled_remix_v1公開終了

鎖城郎郭さんが公開されているマージモデルです。ChilloutMixのライセンスが変更され、商用利用不可となったため、ChilloutMixの画風に似たイラストが生成できるよう作成されたマージモデルです。日本人のアイドル風キャラクターを描きたい方におすすめです。

chilled_remixで生成した画像

配布先

muse_v1

アジア系の人物を高いクオリティで出力できるモデルです。日本人を描きたい方におすすめです。

muse_v1で生成した画像

配布先

ChilloutMix

リアル系では定番となっている、アジア系の人物が綺麗に描けるモデルです。TwitterでもChilloutMixで生成した画像を投稿されている方が多く、私も使用頻度が高いモデルです。商用利用は不可となりますので、ご注意ください。

ChilloutMixで生成した画像

モデルをWebUIで設定する方法

ここからは、入手したモデルファイルをWebUIで使用する方法について解説します。

モデルの設定方法

ダウンロードしたモデルをStable Diffusionのディレクトリに配置します。

実行環境により配置方法が異なりますので、ご利用の環境の項目を参考にしてください。

ローカル環境

ローカル環境で使用する場合は、ローカルPCの以下のディレクトリにモデルファイルを配置してください。

Google Colaboratory

Google Colaboratoryでモデルファイルを配置するディレクトリは以下となります。

Google Colaboratoryの場合は毎回モデルをダウンロードする必要がありますので、自動でダウンロードされるよう以下のコマンドを追加します。

!wget https://civitai.com/api/download/models/15980 -O /content/stable-diffusion-webui/models/Stable-diffusion/museV1_v1.safetensors詳細な追加方法については以下の記事で解説しています。

Paperspace

Paperspaceで使用する場合は、Paperspaceの仮想マシンの以下のディレクトリにモデルファイルを配置してください。

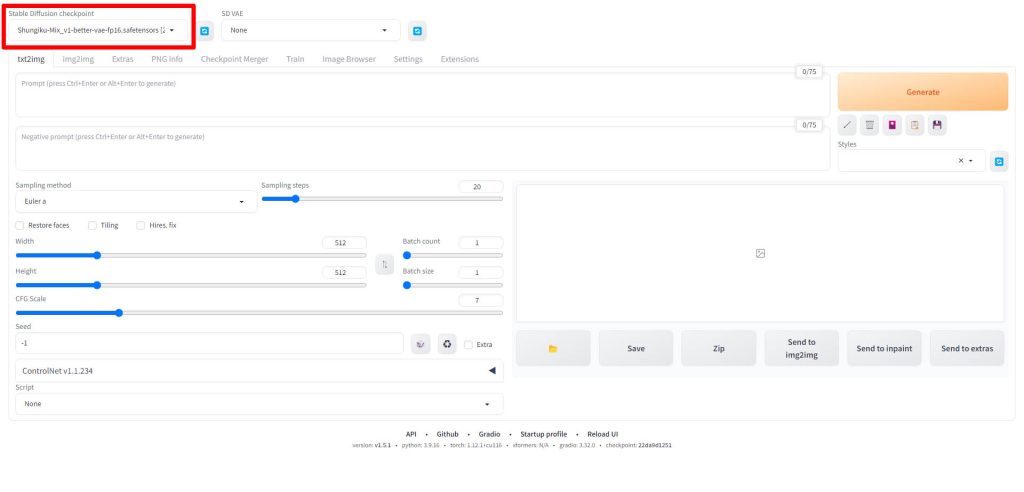

モデルの選択方法

モデルファイルを配置したら、WebUIのを起動します。

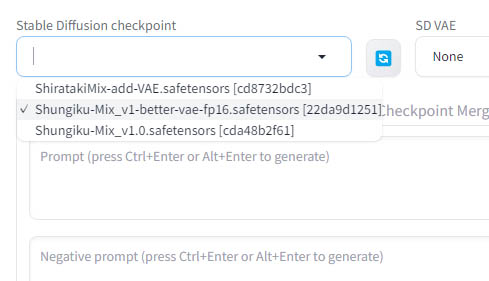

WebUIの画面左上のStable Diffusion checkpointと書かれている項目が、画像生成に使用されるモデルを指定する項目となります。

Stable Diffusion checkpointのドロップダウンリストをクリックすると、先ほどのモデルファイルを配置したディレクトリにあるファイルが一覧で表示されますので、使用したいモデルを選択してください。

以上でモデルの設定は完了です。

プロンプトエンジニアリング(呪文作成)

Stable Diffusionでハイクオリティなリアル系イラストを生成するためには、使用するモデルとあわせてプロンプト(呪文)作成も重要になります。

リアル系イラストに特化したプロンプト作成方法について以下の記事で解説していますので、あわせてご覧ください。

マージモデルを作成する方法

今回紹介したモデルはStable Diffusionユーザーの方が作成、公開されているものです。

お気に入りのモデルが見つかればそれを使っても良いのですが、AUTOMATIC1111の機能を使うと簡単に自分でマージモデルを作成することも可能です。

マージモデルを作成する方法については、以下の記事で解説しています。

キャラクター(人物)のポーズを指定して生成する

Stable Diffusionでは、AUTOMATIC1111 WebUIの拡張機能であるControlNetを使用することで、キャラクター(人物)のポーズを指定して、画像を生成することができます。

ControlNetの使い方については以下の記事で解説しています。

(フォトリアル系モデルでも使用できます)

また、画像生成時に失敗した手の描画についてもControlNetで修正することが可能です。

Stable Diffusionのテクニックを効率よく学ぶには?

カピパラのエンジニア

カピパラのエンジニアStable Diffusionを使ってみたいけど、ネットで調べた情報を試してもうまくいかない…

そんな時は、操作方法の説明が動画で見られるUdemyがおすすめだよ!

動画学習プラットフォームUdemyでは、画像生成AIで高品質なイラストを生成する方法や、AIの内部で使われているアルゴリズムについて学べる講座が用意されています。

Udemyは講座単体で購入できるため安価で(セール時1500円くらいから購入できます)、PCが無くてもスマホでいつでもどこでも手軽に学習できます。

Stable Diffusionに特化して学ぶ

Stable Diffusionに特化し、クラウドコンピューティングサービスPaperspaceでの環境構築方法から、モデルのマージ方法、ControlNetを使った構図のコントロールなど、中級者以上のレベルを目指したい方に最適な講座です。

画像生成AIの仕組みを学ぶ

画像生成AIの仕組みについて学びたい方には、以下の講座がおすすめです。

画像生成AIで使用される変分オートエンコーダやGANのアーキテクチャを理解することで、よりクオリティの高いイラストを生成することができます。

まとめ

今回はStable Diffusionでリアル系イラストを生成できるモデル、LoRAを紹介しました。今後も新しいモデルが公開されたら随時追加していきます。

また、以下の記事で効率的にPythonのプログラミングスキルを学べるプログラミングスクールの選び方について解説しています。最近ではほとんどのスクールがオンラインで授業を受けられるようになり、仕事をしながらでも自宅で自分のペースで学習できるようになりました。

スキルアップや副業にぜひ活用してみてください。

スクールではなく、自分でPythonを習得したい方には、いつでもどこでも学べる動画学習プラットフォームのUdemyがおすすめです。

講座単位で購入できるため、スクールに比べ非常に安価(セール時1200円程度~)に学ぶことができます。私も受講しているおすすめの講座を以下の記事でまとめていますので、ぜひ参考にしてみてください。

それでは、また次の記事でお会いしましょう。

コメント